| ||||||||||||||||

| ||||||||||||||||

| ||||||||||||||||

|

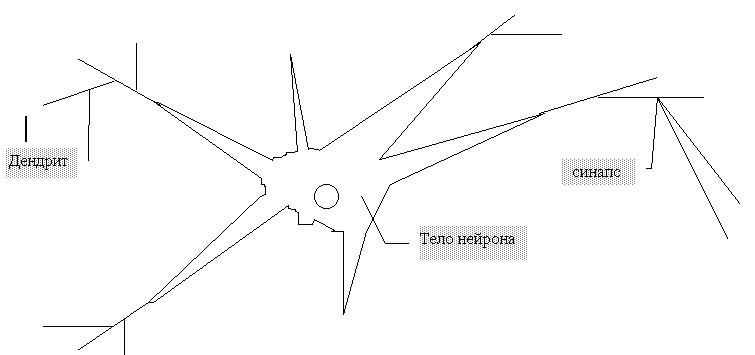

Теория построения Нейрокомпьютерных сетей Введение Плохая изученность принципов функционирования человеческого мозга заставляет ученых выходить за пределы современных биологических знаний в поисках структур , способных выполнять полезные функции . Поэтому очень слаба связь с биологией , ИНС продолжают сравнивать с мозгом т.к. их функционирование напоминает человеческое познание . Краткая историческая справка Человеческий мозг состоит из огромного числа нейронов ,связанных и взаимодействующих между собой . С развитием науки и техники , ученым удалось создать математические модели мозга , что показало не только их способность повторять функции мозга , но и способность выполнять функции , имеющие свою собственную ценность. То есть появились два направления нейронного моделирования : 1. понять механизмы функционирования нервной системы человека на уровне физиологии и психологии . 2. создать ВС , выполняющие функции сходные с функциями мозга Д. Хэбба в 1949 г. предложил закон обучения искусственных нейронных сетей (ИНС). 50-60 гг. первые искусственные нейронные сети . Минский , Розенблатт , Уидроу и др. разработали сети состоящие из одного слоя нейронов (персептроны) . Они были использованы для широкого класса задач ( предсказание погоды , анализ ЭКГ) . Далее не велись работы два десятилетия после доказательства Минского о неспособности однослойных сетей решать многие простые задачи . В 80-90 гг. возобновились разработки ИНС ,которые показали , что Минский был слишком пессимистичен. Биологический нейрон Нервная система человека имеет 100000000000 нейронов участвующих примерно в 1000000000000000 передающих связях . Способность нейрона - обработка и передача электрохимических сигналов по нервным путям , которые образуют коммуникационную систему мозга. Дендриты идут от тела клетки к другим нейронам , где они принимают сигналы в точках соединения , называемых 'синапсами '. Принятые сигналы суммируют и подходят к телу нейрона , когда их сумма превышает некоторый порог , нейрон возбуждается и передает сигнал другим нейронам .

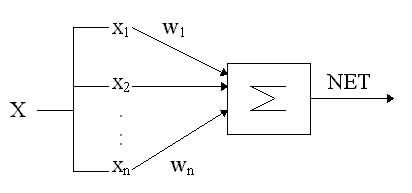

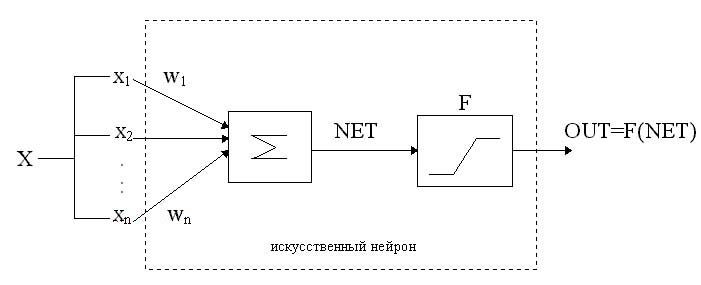

Искусственный нейрон Искусственный нейрон. X={x1,x2, ... , xn} - множество входных сигналов ( соответствует сигналам , приходящим в синапсы биологического нейрона). W={w1,w2, ... , wn} - вес который соответствует 'силе' одной биологи ческой синаптической связи .

NET - выход блока суммирования.

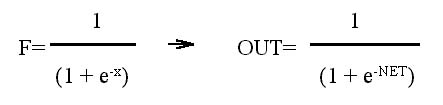

Активационные функции

F - активационная функция , преобразующая сигнал NET . Если блок F сужает диапазон изменения OUT так , что при любых значениях NET , значения OUT принадлежат некоторому конечному интервалу , то F называется 'сжимающей ' функцией . В качестве примера показана наиболее часто используемая логистическая или ' сигмоидальная ' (S - образная) функция .

По аналогии с электронными системами активационную функцию можно считать нелинейной усилительной характеристикой искусственного нейрона . Коэффициент усиления это отношение приращения OUT к приращению NET , он выражается наклоном кривой. Центральная область логистической функции , имеющая большой коэффициент усиления решает проблему обработки слабых сигналов , в то время как , области с падающим усилением на положительном и отрицательных концах подходят для больших возбуждений. Вывод : нейрон функционирует с большим усилением в широком диапазоне уровня входного сигнала.

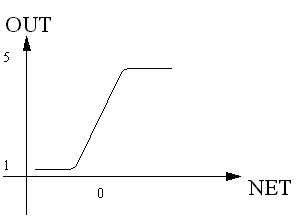

Другой широко используемой исходной по форме с ней функцией является гиперболический тангенс . Она часто используется биоло гами в качестве математической модели активации нервной клетки. OUT = th( x ) - является S - образной функцией

Свойства : 1. не принимают во внимание задержки во времени ко торые воздействуют на динамику системы . Входные сигналы сразу же порождают выходные. 2. не учитывать воздействий функций частотной модуля ции или синхронизирующей функции биологического нейрона , что является очень важным свойством для построения ИНС. Однослойные ИНС

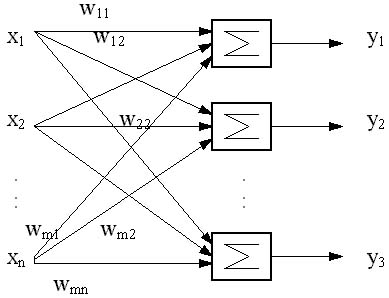

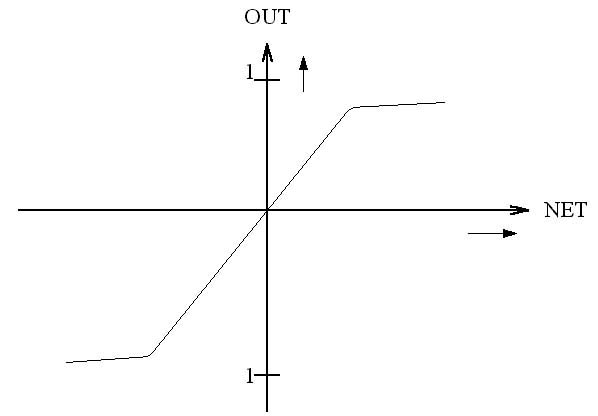

W - матрица весов , она имеет m - строк ( число входов) и n - столбцов (число нейронов) w32 - это вес , связывающий третий вход со вторым нейроном N={y1 , y2 , ... , yn} - сигналы на выходе

Многослойные ИНС 1. нелинейная активационная функция

N = ( XW1) W2 = {т.к. умножение матриц ассоциативно} = X(W1W2) Это показывает, что двухслойная линейная сеть эквивалентна одному слою с весовой матрицей, равной произведению двух весовых матриц То есть многослойные ИНС с нелинейной активационной функцией между слоями не приводят к увеличению вычислительной мощности по сравнению с однослойной. 2. сети с обратными связями Сети более общего вида , имеющие соединения от выхода к входам, называются сетями с обратными связями . У сетей без обратных связей нет памяти , их выход полностью определяется текущими входами и значениями весов .В некоторых конфигурациях сетей с обратными связями предыдущие значения выходов возвращаются на входы . Выход ,следовательно , определяется как текущим входом , так и предыдущими выходами . По этой причине сети с обратными связями могут обладать свойствами , сходными с кратковременной человеческой памятью , сетевые выходы частично зависят от предыдущих входов. Обучение ИНС Самое важное свойство ИНС - это их способность к обучению , которое сильно напоминает процесс интеллектуального развития человеческой личности .Конечно пока возможности обучения сетей ограничены но уже есть некоторые достижения как например ' говорящая сеть ' Сейновского . цель обучения : Сеть обучается ,чтобы для некоторого множества входов давать желаемое множество выходов. Обучение осуществляется путем последовательного предъявления входных векторов с одновременной подстройкой весов в соответствии с определенной процедурой . В процессе обучения веса сети постепенно становятся такими , чтобы каждый входной вектор вырабатывал выходной вектор .

обучение с учителем : Для каждого входного вектора существует целевой вектор , представляющий собой требуемый выход ( обучающая пара ). Выход сети сравнивают с целевым вектором и разность ( ошибка ) с помощью обратной связи подается в сеть и веса изменяются в соответствии с алгоритмом минимизации ошибки . обучение без учителя : Это более правдоподобная для биологической системы модель обучения ,развитая Кохоненом и другими. Обучающее множество состоит лишь из входных векторов . Обучающий алгоритм подстраиваетвеса сети так , чтобы получались согласованные выходные векторы , т.е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения ,следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы . алгоритмы обучения : Большинство современных алгоритмов обучения выросло из концеп ций Хэбба .Им предложена модель обучения без учителя , в которой синаптическая сила (вес) возрастает ,если активированы оба нейрона, источник и приемник . Таким образом часто используемые пути в сети усиливаются и феномен привычки и обучения через повторение получает объяснение . ИНС ,использующей обучение по Хэббу ,наращивание весов определяется произведением уровней возбуждения передающего и принимающего нейронов . Это можно записать как

wij(n) - значение веса то нейрона i к нейрону j до подстройки wij( n+1 ) - значение веса то нейрона i к нейрону j после подстройки alpha - коэффициент скорости обучения OUTi - выход нейрона i и вход нейрона j OUTj - выход нейрона j Сети ,использующие обучение по Хэббу ,конструктивно развивались, однако за последние 20 лет были развиты более эффективные алгоритмы обучения например алгоритмы : Гроссберга , Уидроу-Хоффа. |

|

|

| ||||||||||||||||

|